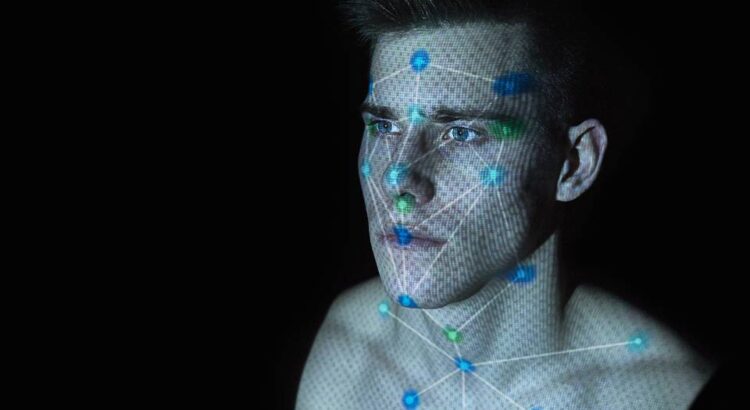

El texto propone un marco normativo para tecnologías controvertidas como el reconocimiento facial o para los sistemas de recomendación de las plataformas

Los Estados miembro de la Unesco cuentan desde ahora una guía para “afrontar de manera responsable los efectos conocidos y desconocidos de la inteligencia artificial en los seres humanos, las sociedades y el medio ambiente y los ecosistemas”. Ese es el objetivo de la Recomendación sobre la Ética de la Inteligencia Artificial, una suerte de declaración universal para el uso de estos sistemas que durante la conferencia general celebrada este miércoles fue adoptada por los 193 países del organismo. La guía contempla los principios que deben inspirar el desarrollo de tecnologías tan controvertidas como el reconocimiento facial y aborda también temas menos polémicos, como el potencial efecto de los sistemas de recomendación sobre la diversidad cultural o lingüística. “Este texto establece por primera vez un marco normativo mundial para el uso de la inteligencia artificial. Se basa para ello en tres pilares: el respeto de los derechos humanos, el Estado de Derecho y la lucha contra la discriminación”, explica a EL PAÍS Audrey Azoulay, directora general de la Unesco.

El documento de 30 páginas que Azoulay describe como un “texto histórico” no es legalmente vinculante, pero desde la Unesco esperan que se convierta en una referencia global para el desarrollo y uso ético de esta tecnología. En este contexto conviven ya numerosos marcos y guías desarrollados por organizaciones de diferentes niveles, desde la iniciativa de entidades como la OCDE hasta propuestas como la carta de derechos digitales adoptada por el gobierno español el pasado 14 de julio. “La Unesco pide a sus 193 Estados miembros que tomen todas las medidas necesarias para aplicar este marco ético. La Organización evaluará periódicamente su aplicación, pidiendo a los Estados que informen sobre sus progresos y prácticas en este ámbito. Estos resultados serán analizados por expertos y sometidos a debate público de forma transparente”, precisa Azoulay.

En la redacción del documento, que se inició a principios de 2020 han participado grupos de expertos formados por representantes de Google, Facebook, Microsoft, las Universidades de Stanford y Nueva York, la Academia China de Ciencia y Tecnología. En septiembre del año pasado, se presentó un primer borrador y se abrió el plazo para que los países de la Unesco presentasen sus comentarios y observaciones sobre el texto, que ha seguido revisándose hasta la última conferencia general.

Entre las claves de la recién adoptada recomendación se encuentra la acotación de principios básicos que atañen al desarrollo de algunas de las tecnologías más cuestionadas del momento, como los sistemas de reconocimiento facial. De acuerdo con el documento adoptado por la Unesco, que cuenta con países como China entre sus integrantes, estos sistemas “no deberían ser utilizados con fines de vigilancia masiva o rendición de cuentas sociales”. En el caso de las armas autónomas, la subdirectora general de Ciencias Sociales y Humanas de la Unesco, Gabriela Ramos, explica en un comunicado que, aunque no se hace referencia explícita a los drones de uso militar ni al armamento autónomo letal, la recomendación establece normas básicas como el que “las decisiones de vida o muerte no deben ser tomadas por sistemas de inteligencia artificial” y se especifica que en estos escenarios “la última palabra debe ser humana”.

La recomendación también aborda escenarios menos extremos pero igualmente relevantes, como el potencial efecto de los sistemas de recomendación que emplean las plataformas de streaming como Netflix o Spotify en la diversidad cultural y lingüística. Un reciente informe de la Unión Europea señalaba que los criterios que emplean estos modelos para ofrecer nuevos contenidos “no son transparentes ni auditables” y probablemente basan sus decisiones en factores económicos que benefician a las plataformas. “Los artistas locales o los contenidos creativos y culturales infrarrepresentados son menos proclives a aparecer en las recomendaciones de estos sistemas si sus trabajos o espectáculos son insuficientemente lucrativos”, señala el informe. En este contexto, la recién estrenada guía hace un llamamiento a los países para que trabajen mejor comprensión y evaluación tanto de los efectos positivos como de los potencialmente perjudiciales de los sistemas de recomendación.

Las relaciones humano-robot

Con vistas a un hipotético pero cada vez más plausible futuro donde las personas interactuemos con robots y sistemas de inteligencia artificial capaces de reconocer y reproducir las emociones humanas, el documento requiere que se evalúen las implicaciones éticas de estas relaciones, especialmente cuando se establecen con menores. “La constante interacción con tecnología de inteligencia artificial, incluyendo los algoritmos sociales, podrían someter a niños y adultos a manipulaciones y consecuencias negativas para su salud mental”, continúa Ramos. Por otra parte, se subraya la necesidad de que los individuos estén en todo momento informados de si están tratando con uno de estos sistemas o son objeto de decisiones tomadas por ellos. Se pide también que se establezcan mecanismos para acceder a las razones que guían una decisión que afecta a los derechos o libertades de los usuarios, así como vías para impugnarla o solicitar una reevaluación.

Otras materias incluidas en el marco de esta recomendación son la protección de la privacidad, la prevención de los sesgos que puedan perjudicar al rendimiento de estos sistemas, la promoción de un entorno más inclusivo en el sector responsable de desarrollar estas tecnologías o incluso la reducción del impacto ambiental de estos sistemas. De acuerdo con un estudio publicado en la revista Nature, entrenar un algoritmo de inteligencia artificial puede producir cerca de 300.000 kilos de dióxido de carbono, lo que equivale a 125 vuelos de ida y vuelta entre Nueva York y Pekín.

Además, el documento que acaba de adoptar la Unesco exige que los gobiernos eduquen a sus ciudadanos en los derechos digitales que pretende proteger. “Si educamos a una nueva generación de consumidores digitales conscientes de sus derechos y con las habilidades de pensamiento crítico necesarias para navegar la esfera digital, estaremos empoderándoles para que exijan a las grandes tecnológicas a rendir cuentas y estaremos exigiendo que la IA sea desarrollada de forma humana y ética”, sentencia Ramos.

Fuente: https://elpais.com/tecnologia/2021-11-25/la-unesco-saca-adelante-la-declaracion-universal-de-la-inteligencia-artificial.html

:quality(70)//cloudfront-us-east-1.images.arcpublishing.com/semana/DVGJTWIHOFC23NCNJU3BURSH44.jpg)

:quality(70)//cloudfront-us-east-1.images.arcpublishing.com/semana/RMRXC6YNCBBRDC5ONDN5CSHLZI.jpg) Uno de los primeros países en utilizar esta novedosa tecnología fue China, que la han usado a modo de salvaguarda de la seguridad en las calles, allí existen más de 300 millones de cámaras de seguridad, motivo que les permite reconocer en pocos segundos a una persona entre la multitud. – Foto: AFP

Uno de los primeros países en utilizar esta novedosa tecnología fue China, que la han usado a modo de salvaguarda de la seguridad en las calles, allí existen más de 300 millones de cámaras de seguridad, motivo que les permite reconocer en pocos segundos a una persona entre la multitud. – Foto: AFP

Este modelo de enfoque en las guarderías, que comenzó a popularizarse durante los años 60 en el norte de Europa, permite a los alumnos disfrutar de un tiempo de juego indefinido en un ambiente natural. Así, en lugar de sentarse en clase y seguir las actividades propuestas por el docente, son libres de explorar y centrar su atención en aquellos elementos que deseen.

Este modelo de enfoque en las guarderías, que comenzó a popularizarse durante los años 60 en el norte de Europa, permite a los alumnos disfrutar de un tiempo de juego indefinido en un ambiente natural. Así, en lugar de sentarse en clase y seguir las actividades propuestas por el docente, son libres de explorar y centrar su atención en aquellos elementos que deseen.

Users Today : 64

Users Today : 64 Total Users : 35459970

Total Users : 35459970 Views Today : 80

Views Today : 80 Total views : 3418545

Total views : 3418545