Luis Bonilla-Molina

Introducción

Las dinámicas de internacionalización universitaria, al ser un continuo histórico, se imbrican y entrelazan en distintos momentos. En el caso de la internacionalización universitaria neoliberal, si bien su auge es a partir de los setenta del siglo XX, es imposible comprenderla sin vincularla a hechos y procesos que le precedieron, especialmente a finales de los cincuenta y en el conjunto de la década de los sesenta, así como en su continuidad durante la égida neoliberal desde los ochenta.

Lo que es cierto es que ya no resulta suficiente decir que hay que hacer lo contrario a lo que plantee el capitalismo para contar con una propuesta alternativa, porque ahora el mercado “invade” nuestro campo y lo resemantiza, haciendo más compleja la distinción de orientaciones estratégicas.

En las próximas líneas mostraremos estos problemas y los cursos de cambio educativo que ha abierto el modo de producción capitalista, como relaciones sistémicas e interconectadas.

Tercera revolución industrial e internacionalización universitaria

La tercera revolución industrial formó parte de los cambios importantes ocurridos en las rutinas del modo de producción capitalista en las últimas décadas del siglo XX. La crisis de acumulación, el impacto de la escalada de los precios del petróleo en los setenta, el ocaso del fordismo, el surgimiento de modelos de gestión empresarial posfordistas (Gestión de Calidad Total, el Benchmarking, Justo a Tiempo, entre otros), la globalización neoliberal, crisis de la deuda externa y financiarización de la economía, la mundialización cultural hegemónica, el inicio de un ciclo regresivo -que se mantiene hasta el presente- en las conquistas laborales y de seguridad social como parte del proceso de desmantelamiento del Estado de Bienestar Keynesiano, fueron solo algunos de los elementos del contexto. Las conversaciones Nixon-Kissinger con Mao-Deng que abrieron la senda para el retorno al capitalismo en la China Comunista, se complementaron con la degradación burocrática en la economía -y el conjunto de la sociedad- soviética hasta su implosión años después. La educación no podía quedar ajena a cambios de esta magnitud.

Los sistemas escolares y universidades que conocemos, han sido altamente influenciada por los requerimientos del capital, en el marco de las dos primeras revoluciones industriales. Si bien la universidad como institución es previa al auge del capitalismo industrial, el modo de producción capitalista moldeó su institucionalidad, procesos y dinámicas, a partir de la primera revolución industrial.

Eje de la enseñanza y el aprendizaje fundamentado en la apropiación y divulgación del método científico en todas las áreas, la transición del dogmatismo religioso al laicismo, el conocimiento organizado para la enseñanza de manera escalar de lo simple a lo complejo, su estructura curricular por especialidades, los enfoques disciplinares del aprendizaje, la innovación científica que interactuaban con la tradición tecnológica expresada en ciclos largos de novedades, los perfiles de egreso estudiantil como hilo conductor de la formación profesional, entre otros elementos, marcaron la pauta de la educación superior en el marco de las primeras revoluciones industriales.

En el intersticio, la universidad fue increpada por el capital para que impactara mucho más al desarrollo de las fuerzas productivas, el orden social y la gobernabilidad, mientras desde los sectores populares la demanda era por mayor compromiso con la justicia social, lo que llevó -por estas distintas razones- a incorporar la extensión a las labores de docencia e investigación que realizaba. En ese contexto de movilidad sistémica ocurre el advenimiento de la tercera revolución industrial.

Ernest Mandel (1962) define con claridad los rasgos distintivos de la tercera revolución industrial, que deben ser valorados en la larga transición de máquinas hechas manualmente, a máquinas que hacen máquinas, pasando por las máquinas que producen materias primas y alimentos, hasta llegar -en el presente- a las maquinas que construyen ideas y pretenden construirse en régimen de verdad sobre lo humano.

Para Mandel, La tercera revolución industrial se caracteriza por:

- tendencia al desplazamiento del trabajo vivo por el muerto;

- transferencia progresiva de la fuerza de trabajo dedicada a la producción directa de mercancías a labores de dirección y supervisión de la producción cada vez más automatizada;

- traslado de los costos de la incorporación de la maquinaria automatizada al producto final, lo cual genera un crecimiento colosal en valor e, incremento en la aplicabilidad de agregados de maquinaria automática controlada cibernéticamente (pag.232);

- cambio en las proporciones apropiadas de plusvalor, generados en la misma empresa y en otras empresas involucradas en la cadena de producción;

- incremento de los costos de producción en materia de compra de maquinarias y medios de circulación, mientras decae la inversión en construcción de infraestructura;

- reducción de los periodos de producción de mercancías y de circulación de stock (posfordismo);

- tendencia al incremento de la investigación para la producción e inicio de la caída en investigación en otras áreas;

- periodos más cortos de capital fijo, especialmente de maquinarias, así como la reducción del paradigma de la libre competencia por el de la programación de la producción;

- aumento del capital constante en el valor medio de la mercancía, lo cual implica una mayor composición orgánica del capital;

- intensificación de las contradicciones en el modo de producción capitalista, especialmente entre la creciente socialización del trabajo y la apropiación privada, el valor de uso y el valor de cambio, la acumulación del capital y su valoración, en este último caso abriendo paso a la financiarización de la economía.

En educación, desde la lógica del capital, esto se expresó en:

- demandas de nueva formación profesional y laboral, con perfiles de egreso más polivantes;

- incorporación en la formación profesional y laboral para la gestión de procesos, del emprendimiento, autogestión de la vida, inteligencia emocional, resiliencia, empatía que rompiera con la tradición del conflicto para dirimir las relaciones entre patronos y trabajadores. Este proceso se fue dando lentamente y no de manera simultánea, en las seis décadas siguientes al desembarco de la tercera revolución industrial;

- El desarrollo de sistemas de clasificación y competencia (escolar y universitaria) que atrajeran la inversión privada a la educación pública, permitiendo el impulso de diversas formas de mercantilización y privatización educativa que transfirieran a los ciudadanos los costos de los cambios en curso;

- El auge del modelo de buenas prácticas escolares y universitarias (benchmarking educativo) que fueran abriendo paso a la internacionalización de manera homogénea, especialmente en el modo de entender el trabajo de las instituciones de educación superior;

- La conversión del paradigma liberal del derecho humano a la educación a lo largo de la vida, en un derecho para la empleabilidad;

- El desarrollo de esquemas de transferencia de los costos de formación profesional a los estudiantes y familias (créditos con intereses, cogestión educativa), como una forma de expandir la lógica del mercado en educación;

- Impulso de los esquemas de investigación, docencia y extensión, centrados en la “utilidad” ´para la economía, gobernabilidad y consumo. Eso implicaba reducir o eliminar en los planes de estudio lo que no se vinculaban directamente con la producción, empleo, compra de mercancías, paz social y desarrollo centrado en la acumulación capitalista;

- necesidad de superar el paradigma disciplinar por la transdisciplinariedad y/o el pensamiento complejo,

- esfuerzo sistemático por superar la curricularización rígida de la enseñanza que limitaba las posibilidades de incorporar lo nuevo en tiempo real y, abrir la etapa de la curricularización flexible y abierta. Esta ruptura con la tradición de los sistemas escolares y universidades, respecto a lo que ocurría en las dos primeras revoluciones industriales, ha sido comprendido de manera muy precaria por las propias burocracias educativas afines ideológicamente a la lógica del capital, por lo que muchas reformas siguen centrándose en el currículo prescrito y cerrado;

- surgimiento del paradigma STEM, que centra la labor docente en lo que se debe hacer para acoplar la enseñanza-aprendizaje, a los cada vez más cortos ciclos de innovación científico-tecnológica vinculados a las necesidades del modo de producción capitalista;

- superación de los paradigmas taylorista y fordista en la gestión escolar universitaria, impulsando el paradigma posfordista de calidad en la educación;

- imposición de la cultura evaluativa neoliberal como operación de la internacionalización universitaria para comprobar los avances en la “actualización” de la educación superior respecto a lo que demanda el modo de producción capitalista;

- redefinición de los perfiles de egreso profesional centrándolos ahora en las competencias;

- marco homologado de las competencias escolares y universitarias a escala mundial para facilitar la internacionalización universitaria;

- estandarización de las políticas de cambio educativo, mediante operaciones institucionales y políticas públicas que hagan eficiente la estrategia de internacionalización universitaria (normalización, sistemas seriados, arbitrados e indexados de publicaciones, acreditación universitaria, rankings académicos, micro acreditación, convenios de reconocimiento de títulos, entre otras);

- relanzamiento de las políticas de movilidad estudiantil y académica calificada, para la “racionalización productiva” de la “fuga de cerebros” y el flujo más eficiente de los nuevos paradigmas del centro a la periferia capitalista. En esta estrategia, los órganos nacionales de investigación, ciencia y tecnología, así como los procesos de ascenso académico y asignación salarial en las universidades juegan un rol central.

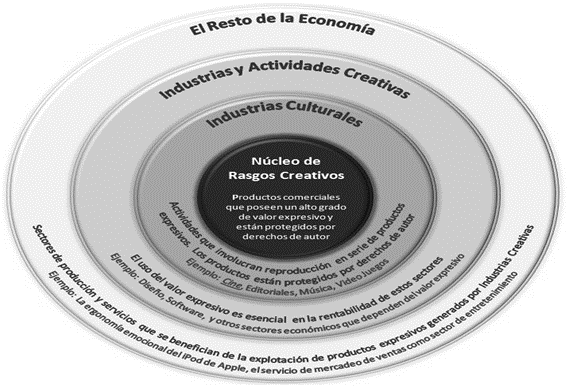

Estos requerimientos, que parecían abstractos, demandaban una traducción educativa en los territorios e instituciones. La academia y los intelectuales alineados con el sistema fueron convocados para generar investigaciones “confirmatorias”, que legitimaran el cambio en curso. El complejo industrial cultural jugó un papel central en la estrategia comunicacional de implantación y consolidación, usando el término polisémico de la calidad como un comodín multiuso.

Homogenización y estandarización: nueva etapa de la internacionalización universitaria

La estandarización es el proceso mediante el cual se establecen criterios y parámetros, ponderables y comparables a nivel mundial, de entrada y salida, para los procesos de enseñanza y aprendizaje. Por otra parte, la homogenización está referida a las dinámicas y rituales institucionales, mediante los cuales se hacen converger e interactuar estos estándares, para alcanzar la estrategia que responda a determinados intereses y correlaciones de fuerza.

La estrategia, en el actual periodo del capitalismo, es la internacionalización universitaria, que procura alcanzar sincronía total entre de las dinámicas de docencia, investigación y extensión universitaria con los requerimientos del modo de producción capitalista en la tercera revolución industrial (y que continúa en la transición a la cuarta revolución industrial). La operación que viabiliza la estrategia es la cultura evaluativa neoliberal.

La cultura de la autonomía universitaria contenía correlaciones de fuerza en la vida académica con las cuales el cambio tenía no solo que dialogar sino alinear. En las instituciones de educación superior (IES) no se puede forzar, al menos en el corto plazo, una transformación de esta significación sin generar caos, conflicto y elevar exponencialmente las resistencias (narrativas y con los poderes políticos, económicos, religiosos y tecnológicos de facto).

Por esta razón, la construcción de viabilidad implicaba -y sigue siendo así- un largo proceso de construcción de falso “sentido común”, que atenuara la percepción de externalidad en la estrategia y posibilitara el proceso de instauración de la internacionalización universitaria neoliberal. En este camino, había que convencer al mundo universitario de la necesidad de evaluar y clasificar de manera estandarizada y homologada la actividad académica, usando para el ello el paradigma de la meritocracia, lo cual demandó décadas, para que no fuera evidente que esta estrategia capitalista era una violación de la autonomía universitaria.

En la tercera década del siglo XXI, es evidente que el capitalismo ha logrado “naturalizar” la bibliometría, los rankings, la acreditación universitaria, la movilidad profesoral y estudiantil basada en la inmersión en las “buenas prácticas” y la mercantilización de la productividad académica. Este es el mayor triunfo de la cultura evaluativa neoliberal.

La estandarización y homogenización ha sido una tendencia constante en el tiempo histórico de la universidad latinoamericana y caribeña, pero nunca había alcanzado las dimensiones, ni logrado tal grado de cohesión y direccionalidad, como lo ha hecho a partir de la tercera revolución industrial.

Por supuesto, la internacionalización universitaria neoliberal requiere una “adaptación nacional” para poder presentar las acciones que converjan con esta estrategia, como propias y singulares, iniciativas locales que van al encuentro de lo global, cuando en realidad el proceso se ha generado a la inversa. Al instaurarse a nivel mundial la cultura evaluativa neoliberal -corazón de la internacionalización universitaria- el capitalismo pretende desarrollar una dialéctica entre lo global y lo local, que le permita hacerla más eficiente.

El problema reside en la complejidad de las interacciones sistémicas de las operaciones propias de la estrategia de internacionalización universitaria, que suelen aparecer para las burocracias institucionales y el común, como autónomas, fragmentadas, desconectadas y difusas. Al no captarse la direccionalidad y sentido complementario de las operaciones de la internacionalización universitaria, esto puede conducir a errores de priorización desigual de las mismas o de omisión de alguna de ellas, afectando las posibilidades de logro para la lógica del capital.

Sin embargo, como lo explica Anderson (1991), lo nacional es una comunidad imaginada que comporta subjetividades, porque “los miembros de la nación … no conocerán jamás a la mayoría de sus compatriotas, no los verán ni oirán siquiera hablar de ellos, pero en la mente de cada uno vive la imagen de su comunión” (pág. 24). En el caso de Latinoamérica, no suele haber una idea de la “educación nacional” diferenciada de manera sustantiva en lo escolar y universitario global de lo externo, como tampoco se está exento de las antiguas y nuevas formas de colonización cultural que impone en materia educativa el sistema mundo capitalista. En consecuencia, la identidad educativa nacional muchas veces suele ser un espejismo, más aún si se combina con la calidad educativa.

Por ejemplo, los órganos nacionales para la promoción de la investigación, ciencia y tecnología, que se fueron creando y extendiendo como una hiedra en la región -después de la segunda guerra mundial y el marco del surgimiento de la tercera revolución industrial- promovidos por la mirada cepalina (naciones Unidas) del desarrollo, hicieron posible que, desde la externalidad del mundo universitario, las ideas de lo nacional en las políticas universitarias estuvieran alineadas a los objetivos que para el sector le imponía el centro a la periferia capitalista.

Se suele pensar el papel de estos organismos para la promoción de la ciencia, investigación y tecnología como apoyos al sector universitario, cuando en realidad su trabajo ha significado formas sui generis de quebrar la autonomía universitaria, debido a tres factores. Primero, el presupuesto asignado a estas instancias debió ser asignado directamente a las propias universidades y, en la medida que se incrementa su porcentaje tiene efectos colaterales de desinversión para las IES. Segundo, la priorización de agendas de investigación, docencia y extensión desde un lugar de enunciación ajeno a la universidad que sufre problemas de precarización presupuestaria, se convierte en una injerencia indirecta en la definición de prioridades, lo cual vulnera la propia autonomía. Tercero, estos organismos crean un referente de autoridad en la gestión universitaria que depende de los gobiernos centrales y, por lo tanto, sus prioridades (docencia, investigación y extensión) no suelen ser las de la academia, sino las de la superestructura política.

En sus inicios, la “mediación” de estos órganos nacionales de ciencia, tecnología e investigación, adquiría especial importancia ante la ausencia -o debilidad institucional- de ministerios dedicados exclusivamente al sector universitario, así como por la precaria experticia y autoridad que sobre la educación superior tenía en sus inicios la UNESCO[2]. Lo cierto es que el desarrollo del multilateralismo de la post guerra, mostró la renovada vocación de internacionalización educativa (dentro de ella la universitaria) que tendría el capitalismo en la tercera revolución industrial.

Cómo en las alternativas anti sistema -diríamos hoy anticapitalistas- el internacionalismo era un principio orgánico, la internacionalización educativa -y universitaria- en muchos casos fue erróneamente valorada como progresista. Aún más, cuando la UNESCO -promotora de la normalización educativa– en el marco de la guerra fría, jugaba el rol de espacio de encuentro entre el mundo capitalista y el socialista soviético. Eso no solo facilitó la legitimación de UNESCO, sino que le dotó de un falso manto de neutralidad, que hoy perdura en amplios sectores del magisterio.

Esto no niega ni procura obviar los esfuerzos autónomos por construir políticas educativas nacionales, las cuales han surgido en el marco de las contradicciones inter burguesas, nacionalistas o de carácter nacional popular, como tampoco lo que significó la revolución cubana (1959) en la región. Lo que pretendemos subrayar es el carácter hegemónico y estandarizado que va tomando la internacionalización universitaria, en la tercera revolución industrial y la fase de hegemonía imperialista de los Estados Unidos.

Discurso político, poder e internacionalización

Lacan (1974) en “Reverso del Psicoanálisis” identifica cuatro niveles de la producción del discurso político en las relaciones de poder, los cuales marcan la dinámica entre opresión y liberación. Estos cuatro niveles son: a) el discurso sin límites del amo castrado, b) el papel de la academia en la construcción de narrativas que legitimen la posición del amo, c) la histeria del común, marcada por los “límites” impuestos por el amo, d) el papel del analista “subversivo” (el saber cómo medio de goce) que intenta construir narrativas que develen esta realidad.

A los efectos de este trabajo, parafraseando a Lacan, nos interesa identificar, en un primer momento, la política del “amo capitalista”, que se expresa en varios y complementarios proyectos económicos simultáneos del capital[3] que, si bien tienen diferencias en las disputas por las ganancias derivadas de los mercados educativos, comparten la orientación estratégica de la internacionalización universitaria.

En un segundo momento, entender el “despiste universitario” sobre la orientación política, económica e ideológica de la internacionalización universitaria que se implementa, generándose con ello una crisis de comprensión sobre el sentido real de la misma y, vacíos en el corpus analítico alternativo, que limitan la capacidad autónoma para pensar y elaborar políticas públicas universitarias sobre la internacionalización. La academia de derechas y vinculada a la lógica del capital, solo atinó a realizar estudios confirmatorios, pero no tuvo la capacidad de abrir caminos para implantar lo nuevo-

Tercero, se ha generado una “histeria” colectiva sobre la calidad educativa, un término polisémico y por lo tanto ambiguo, que asociado a la estrategia de internacionalización universitaria construye falso sentido común sobre lo que la ciudadanía aspira para la educación de sus hijos, la propia y de la comunidad. Esto justifica las políticas educativas asociadas a este fenómeno, limitando las resistencias a la cultura evaluativa neoliberal (competencia, clasificación, estratificación, movilidad) implícita en la internacionalización universitaria.

Cuarto, lo que incomoda a la hegemonía imperante, es la construcción desde abajo y los márgenes, de narrativas, prácticas y propuestas colectivas que develen el sistema de relaciones de poder constituidos alrededor y dentro de la internacionalización universitaria. Lo subversivo es analizar y mostrar, que la internacionalización universitaria tiene como lugar de enunciación la racionalidad capitalista y, no la autonomía académica. La perversión de la reproducción funcional se supera con el goce del saber crítico.

Las metáforas lacanianas nos sirven para ilustrar que lo que está en juego es una disputa sobre los sentidos de la actividad académica y la internacionalización universitaria.

Crisis educativa

En la narrativa capitalista surgen denominaciones que se usan para construirle viabilidad social a la internacionalización universitaria neoliberal en el marco de la tercera revolución industrial. Las expresiones más usadas son “crisis educativa”, “crisis de la calidad universitaria”, “crisis civilizatoria en la educación superior”. Estos enunciados se han promovido por el centro capitalista, desde la década de los sesenta del siglo XX (seis décadas), muy especialmente en el decenio 1962-1972 (desde el memorándum sobre educación del Banco Mundial hasta el Informe Faure), periodo en el cual se sentaron las bases conceptuales y operacionales de la internacionalización universitaria capitalista.

Desde la lógica del capital, tres grandes sucesos marcan hitos en la construcción de la idea hegemónica de crisis educativa en general y del sector universitario en particular. Primero, determinado por la llegada de la tercera revolución industrial y sus demandas específicas y novedosas sobre la actividad académica. Segundo, los debates impulsados desde las instancias de poder mundial del capitalismo sobre la urgencia de un cambio en los sistemas escolares y universidades. Tercero, la precariedad en la construcción de análisis alternativos contextualizados y en profundidad.

Paradójicamente, también desde el campo popular y revolucionario, la década de los sesenta significó un hito importante en el cuestionamiento de la gestión y orientación estratégica de las universidades. El mayo francés, las movilizaciones antirracistas y contra la guerra de vietnam en los Estados Unidos, el movimiento latinoamericano por la reforma universitaria, las insurgencias estudiantiles en distintos países, planteaban que, ante la crisis de la educación universitaria, había que ser realistas y soñar lo imposible[4].

En consecuencia, la palabra crisis se hizo presente en las dos caras de la moneda, planteando la urgencia de transformar la universidad. En el capitalismo de la tercera revolución industrial se da la paradoja, que desde distintos lugares de enunciación (poder dominante y alternativas), se plantea desde hace seis décadas que hay que cambiar radicalmente la universidad. Las IES, por distintas razones, estaban siendo -y siguen- cuestionadas a nivel global, lo cual fue aprovechado por los impulsores del neoliberalismo para abrir paso a soluciones estandarizadas y homogenizadas en formato de internacionalización universitaria.

Documentos que sirvieron de partida a la internacionalización neoliberal de las universidades

Banco Mundial

Sin pretender simplificar, podemos identificar los principales documentos fundantes de la internacionalización universitaria neoliberal en el marco de la tercera revolución industrial. Estos son:

- el memorándum del Banco Mundial,

- el informe Coleman (1966),

- Los papeles de trabajo y conclusiones de la Conferencia Internacional sobre la Crisis Mundial de la Educación (1967),

- la publicación del libro de Philip Coombs sobre la crisis mundial de la educación (1968),

- la conformación de la Comisión Internacional de UNESCO que elaboró el informe “Aprender a Ser (1972), mejor conocido como Informe Faure.

Luego, estos documentos serían complementados con una serie de trabajos del Banco Mundial, UNESCO (especialmente el IIPE, CRESALC-IESALC y la Dirección de Educación Superior del organismo multilateral), Banco Interamericano de Desarrollo (BID), Naciones Unidas, entre otros. Entre los documentos posteriores es necesario señalar los que circularon para las tres conferencias regionales y mundiales de educación superior, así como la CRES+5 (2024).

Como precisa Bonilla-Molina (2023) en el trabajo “El Banco Mundial en la educación superior (1962-2000)”, esta instancia de conducción de la política económica mundial, creada en el marco del nuevo orden surgido en las postguerras, desplegó abiertamente su trabajo en materia educativa en 1962, con la aprobación del primer proyecto educativo. La labor crediticia del BM en el sector educación, entre 1962 y 1970 se centró en fortalecer las iniciativas de enseñanza, orientadas a atender las demandas de mano de obra del modo de producción capitalista.

Es a partir de septiembre de 1971, cuando el BM en el documento “Education: sector working paper” comienza a perfilar un trabajo internacional de promoción del cambio educativo, mediante el estudio sistemático de los casos nacionales de las Instituciones de Educación Superior (IES). Este documento del Banco Mundial converge con las conclusiones del libro del norteamericano y técnico del IIPE UNESCO Philip Coombs, titulado “The World Crisis in Education: the view from the eighties”. Se inaugura así, una serie de documentos del Banco Mundial, que aún hoy continúan construyendo un marco normativo neoliberal para el cambio universitario, especialmente en materia de internacionalización universitaria.

En el documento de 1971 el Banco Mundial (BM) plantea:

- la necesidad de actualizar la capacidad de gestión del sector universitario a nivel internacional, en sus áreas de organización, planificación, evaluación y supervisión,

- esta actualización debe impactar al currículo y los métodos de enseñanza,

- el crecimiento de la cobertura universitaria debe fundarse en la identificación de nuevas y diversas fuentes del financiamiento de las IES,

- Se necesitan reformas estructurales e integrales y menos cambios sectoriales.

Evidentemente, el BM intentaba alinear las respuestas del sector universitario a los requerimientos de formación, investigación y extensión que emanan del modo de producción capitalista en la tercera revolución industrial. El paraguas sobre el cual construye sus propuestas de cambio es la noción de “crisis educativa”. La estrategia es la internacionalización universitaria con distintas dinámicas convergentes de cultura evaluativa neoliberal.

La intervención abierta del BM en la agenda educativa y, en especial del sector universitario, es una señal inequívoca del interés del sistema en producir un cambio radical en las IES, convocando a todos los actores de la superestructura a esta tarea, procurando eliminar cualquier duda de los gobiernos y los conductores de instituciones al respecto.

Informe Coleman

Después del banderazo de 1962 por parte del BM, el gobierno de la nación imperial surgida de las postguerras mundiales del siglo XX, abre un debate sobre la eficiencia de la educación en su propio patio. De hecho, los intereses estratégicos de los Estados Unidos eran -y son- los más impactados por la vorágine de aceleración de la innovación científico tecnológica que trajo la tercera revolución industrial. Por ello, el interés en actualizar los sistemas escolares y universidades para alinearlos a la reproducción y consolidación de su rol imperial.

El Informe Coleman (1966) constituye un hito en la caracterización de problemas complejos de los sistemas escolares que afectan la gobernabilidad del sistema, incluido el impacto de lo tecnológico en la concentración de riqueza, con la menor generación de desigualdades sociales en su país. El resultado del Informe Coleman instala la idea que la educación norteamericana está en crisis y se debe promover un cambio de manera rápida y efectiva. El meta mensaje consistía en mostrar que esto no era anomalía ni singularidad, sino que la crisis de la educación en Norteamérica y la necesidad de reformas educacionales en ese país, debería ser una regularidad en el resto de las naciones industrializadas, pero también las dependientes, es decir, en el centro y la periferia del sistema mundo.

Este diagnóstico permeó al movimiento social y mediático de los Estados Unidos que comenzaba a ser sacudido por el movimiento hippie, las protestas por la paz en el sudeste asiático, la solidaridad con los movimientos que cuestionaban la racialización de la sociedad, así como por logro de cupo universal para las juventudes en las universidades. La onda de las ideas libertarias del socialismo, la revolución cubana y los cursos de las independencias nacionales en áfrica, así como la beligerancia de las clases subalternas en Asia contribuyeron al surgimiento del protagonismo estudiantil universitario norteamericano y de los países industrializados, que cuestionaban desde otro lugar de enunciación a las IES. El sistema ve a las protestas estudiantiles, el movimiento libertario hippie y la creciente beligerancia social como un signo claro de problemas educativos que tocan a las universidades.

La idea de una nueva reforma educativa recorre al continente latinoamericano y caribeño, mientras desde distintos flancos se cuestiona la legitimidad y eficacia de la formación universitaria en la nación más ´poderosa del planeta.

Conferencia Internacional sobre la Crisis Mundial de la Educación

Esta construcción de hegemonía para la internacionalización del cambio universitario, tiene un capítulo especial en la convocatoria hecha por el propio presidente norteamericano Lyndon Johnson, para la celebración de la Conferencia Internacional sobre la Crisis Mundial de la Educación (1967), a la cual asisten 150 delegados de 52 países que acuerdan promover iniciativas para un cambio de los sistemas escolares y las universidades a nivel mundial, dando un paso gigantesco en la reelaboración de las agendas para la internacionalización, conforme las exigencias del ese momento.

La Conferencia Internacional, sacudida por los resultados del Informe Coleman, llega a la conclusión que la crisis no es exclusiva de los EEUU, sino un rasgo de la educación en el sistema capitalista en su conjunto como resultado de la nueva realidad derivada del impacto de la tercera revolución industrial en el modo de producción capitalista.

Los objetivos centrales de este evento fueron:

- diagnosticar la naturaleza, causas y proyecciones de la crisis mundial de la educación,

- consensuar una estrategia internacional común para enfrentar y superar las causas de esta crisis.

El documento central del evento fue encargado al IIPE-UNESCO, creado en 1962 y dirigido para ese momento por Philip Coombs, quien había estado al frente del Departamento de Educación de los Estados Unidos en la administración Kennedy.

Para la realización de los debates y la construcción del discurso del poder (los amos en el sentido lacaniano), se establecieron diez grupos de trabajo, cada uno dirigido por especialistas del área:

- administración escolar (Dr. King, del departamento de Educación de la OECD),

- finalidades y contenidos de la educación (Dr. Beeby, de la Universidad de Londres),

- estructura de los sistemas escolares (Dr. Bereday, Universidad de Columbia),

- Formación docente (Dr. Butts, Universidad de Columbia),

- democratización de la enseñanza (Bowles, Fundación Ford),

- Educación Informal (Schwartz, Instituto Nacional de Formación de Adultos de Francia),

- Nuevas Tecnologías (Dr. Leussink, Universidad Fridericiana de Karlsrube, Alemania),

- productividad de la educación (Dr. Edding, Instituto de Investigación Pedagógica de Berlín),

- Investigación para Mejorar la Educación (Dr. Husén, Instituto de Investigación Pedagógica de Estocolmo),

- Cooperación Internacional para el Fomento de la Educación (Dr. Quik, Fundación Universitaria de Cooperación Internacional de La Haya).

Las conclusiones, mencionadas por Villa-Gómez (1967) fueron:

- promover un Mercado Común Mundial de la Educación,

- creación de un Consorcio Internacional para la coordinación de los programas de asistencia técnica y financiera en materia educativa,

- duplicar la ayuda internacional en materia educativa en los siguientes cinco años,

- Concentrar la cooperación los llamados países en desarrollo,

- priorizar el financiamiento para la planificación educativa, innovación tecnológica, cambio en los planes de estudio, racionalización y modernización de la administración educativa,

- condicionar la ayuda educativa a los países a cuatro factores:

- la estrategia de aplicación de la ayuda debe estar consensuada entre donantes y sector educación que lo recibe,

- establecer sistema de evaluación periódica de los cambios (imposición de la cultura evaluativa en la gestión educativa),

- la productividad como criterio del apoyo multilateral y de fuentes multinacionales,

- el sistema educativo y las IES que reciben ayuda internacional deben estar alineadas a un plan de desarrollo nacional conforme a la división internacional del trabajo. Estos elementos serían centrales en el curso que tomaría la década siguiente la internacionalización universitaria.

The World Crisis in Education: the view from the eighties

Al año siguiente, el señor Philip Coombs, publica en formato de libro, una versión mejorada de los documentos que había trabajado para la Conferencia Internacional, bajo el título “Crisis Educativa Mundial” (1968), en el cual se amplían los conceptos, afirmaciones, debates y conclusiones de la reunión internacional convocada por el presidente Johnson. El libro de Coombs, al ser una figura mundial de UNESCO, saca el debate de la “crisis educativa” de las fronteras norteamericanas y lo coloca en el propio corazón del organismo multilateral creado por Naciones Unidas para el fomento de la educación, cultura y comunicación.

Aprender a ser: la educación del futuro

Esto obligó al organismo de la Plaza Fontenoy de París, a escalar el debate (de los amos del poder) a nivel planetario. En consecuencia, convoca a la conformación de una comisión internacional que estudió el “estado de la educación mundial”. Si bien la convocatoria a la investigación no se alinea inicialmente con la idea de “crisis educativa”, los resultados de la misma si lo harían.

En el apartado “puntos de referencia actuales” de “Aprender a Ser: la educación del futuro” se parte del enunciado que la “sociedad rechaza los productos de la educación” (pag.62) porque la educación que precedía las transformaciones económicas, tecnológicas y culturales ha perdido esa capacidad y, en consecuencia, ha diluido sus posibilidades de prever el futuro inmediato con conocimiento adecuado para cada tiempo histórico.

En el inciso “desigualdades en la universidad” el informe Faure, se crítica el efecto de los paliativos para promover la igualdad de oportunidades, si estos no están vinculados a una estrategia integral de meritocracia que sea capaz de superar los obstáculos internos, que además pueda ser valorada adecuadamente mediante modelos de evaluación institucional.

Lo que confirma el Informe Faure (1973) es la necesidad de un cambio radical de la universidad y los sistemas escolares, que se abra paso mediante una adecuada cultura evaluativa de las IES y el resto de instituciones educativas para lograr recuperar su capacidad de prever y preceder.

A partir de este momento, la máscara altruista y despolitizada de la UNESCO comenzó a caerse, mostrándose como un aparato trasnacional o multilateral alineado a los intereses dominantes, algo que analizamos en profundidad en otros textos.

Las “soluciones” del capitalismo en materia educativa, comenzaron a plantearse abiertamente como mundiales, estandarizadas y comparables, para tratar de producir un giro en los sistemas escolares y las universidades. A esa operación se le dio el nombre de internacionalización y tomó variadas formas: normalización educativa, acuerdos para el reconocimiento de títulos y convalidación de estudios en diferentes países, compatibilidad curricular, sistemas de serialización de publicaciones, mecanismos de arbitraje e indexación, financiamiento de la movilidad académica y estudiantil, promoción de la migración calificada, generación de las categorías e indicadores para la medición y clasificación, sistemas de acreditación universitaria, rankings universitarios, micro acreditación de estudios, diversificación del financiamiento universitario, procesos de neo privatización (diversificación de las fuentes de financiamiento público, transformación digital de la educación) y deslocalización de los centros de enunciación de políticas educativas (filantropía empresarial, empresarios por la educación, otras formas de sociedades económicas).

Como veremos más adelante, las Conferencias Regionales de Educación Superior (CRES 1996, 2008, 2018, CRES+5 2024), las Conferencias Mundiales de Educación Superior (1998, 2009, 2022), los acuerdos multilaterales y las convenciones mundiales fueron instrumentos para su aplicación, cumpliendo además la función de válvulas de escape para las críticas a la tendencia hegemónica.

En este periodo, la internacionalización se asume ya no como una adaptación nacional a las experiencias exitosas ubicadas en otras latitudes -propio de los ciclos anteriores-, sino como una necesidad del sistema mundo de alinear los esfuerzos universitarios en una misma dirección, independientemente de las graduaciones propias del desarrollo desigual y combinado del capitalismo, en un nuevo contexto de nueva división internacional del trabajo, incluido el profesional e intelectual.

La innovación como problema

La pregunta natural que surge es ¿por qué en ese momento el capital redobla su discurso sobre la crisis educativa? ¿Le llegó la hora a la transformación radical de los sistemas escolares y universidades? ¿Por qué el sistema mundo no lo hizo antes? Siempre se dijo desde la teoría crítica que los sistemas escolares y universidades habían servido para la reproducción simbólica y material del modo de producción capitalista ¿que había cambiado entonces?

Fuente de la Información: https://luisbonillamolina.com/2024/11/30/la-internacionalizacion-universitaria-de-la-tercera-revolucion-industrial-1972-1980/

Users Today : 122

Users Today : 122 Total Users : 35459588

Total Users : 35459588 Views Today : 198

Views Today : 198 Total views : 3417956

Total views : 3417956