Por: La tinta

La foto del papa Francisco con un camperón blanco se hizo viral, la de Trump siendo arrestado también y ambas fueron creadas con inteligencia artificial. Circulan noticias, discursos, pruebas de actividades y preguntas hechas al chatbot GPT. Las redes estallaron con debates de todo tipo sobre esta transformación tecnológica que hace tiempo llegó. Conversamos con Javier Blanco, doctor en Informática y docente en la UNC, para que nos oriente acerca de dónde poner el foco en esta discusión.

Cada época tiene sus avances tecnológicos que ponen en dudas el futuro, que traen la incertidumbre de cómo será la vida con tal desarrollo. La Inteligencia Artificial (IA) es el tema central de muchas conversaciones por estos días y las redes están estalladas. Hay notas que titulan: “Los 10 empleos que la inteligencia artificial eliminará primero y los que están a salvo”. Como si no tuviéramos frentes sobre los que preocuparnos, ahora esto. ¿Sirve escandalizarnos de los posibles impactos negativos que trae la IA o necesitamos enfocar el debate? ¿Cancelamos y nos subimos a la ola apocalíptica, o buscamos elementos para una postura más reflexiva? Adivinen.

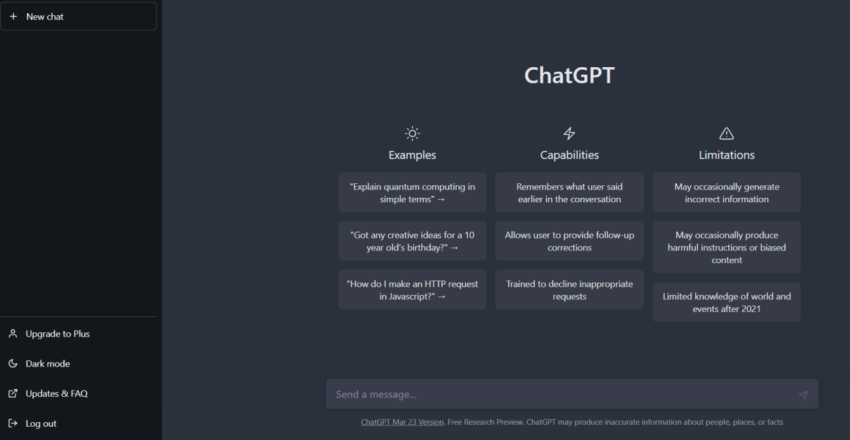

En noviembre pasado, la compañía OpenAI de Elon Musk presentó el chat GPT y, rápidamente, fue probado por muchísimos usuarios. Google también anunció el lanzamiento de una herramienta similar. ¿Pero cuáles son las novedades que traen estos chatbot? Ya existen algunos que son usados por distintas instituciones, por ejemplo, Boti, empleado por el gobierno de CABA. Rápidamente, también, surgieron las reflexiones vinculadas al reemplazo de funciones que hacemos los seres humanos. ¿Será? Hay miles de ejemplos circulando en las redes sobre preguntas formuladas al GPT. Asusta, en principio, el tono alejado de lo que imaginamos como un robot o máquina; respuestas coherentes, precisas, argumentadas y reflexivas. En las últimas semanas, se hicieron virales imágenes creadas con IA: la del papa Francisco usando un camperón blanco, Trump siendo detenido, entre otras. Esto desató debates éticos y sobre el impacto en la construcción de la verdad a futuro y la reproducción de fakes.

Y como estamos en un mood todo es confusión y nos empantanamos en discursos del colapso, conversamos con Javier Blanco, doctor en Informática por la Universidad de Eindhoven, Países Bajos, profesor titular de FAMAF y director de la Maestría en Tecnología, Política y Culturas de la UNC. Lo primero que destaca es que el sintagma inteligencia artificial es problemático, ya que representa cosas diferentes y en ningún caso es algo lineal o simple. El especialista advierte que las connotaciones tanto de lo artificial como de la inteligencia son pregnantes, suele ser difícil pensar bien el concepto y se gasta tiempo en discusiones ociosas acerca de si la inteligencia es solo humana, qué es lo de artificial y cuestiones del estilo.

“No hace falta discutir si es inteligencia o no, son programas o artefactos cognitivos sin duda. La inteligencia humana como tal no es ningún paradigma de nada y es lo que la evolución pudo hacer. Yo hablaría de inteligencias, de un paisaje de inteligencias posibles donde las inteligencias artificiales y las humanas son parte. Lo interesante es pensar el acoplamiento de esos sistemas cognitivos. La inteligencia humana es y siempre fue en parte artificial y extendida, las mentes son tales en tanto disponen de andamiajes externos: pensamos porque podemos ver, tocar, porque tenemos un ábaco, un papel o un algoritmo. Todo pensamiento es originariamente híbrido y distribuido técnicamente”.

—Se plantea que el GPT transformaría las aulas y los procesos de enseñanza y aprendizaje, así como la desaparición de profesiones. Se instala la pregunta de si hay que temerle o no, de si puede ser o no una aliada. ¿Qué cambia en la educación la presencia de ese tipo de tecnología? ¿Se puede aprovechar para los procesos de enseñanza y aprendizaje?

—Los sistemas de producción de textos como el chat GPT y otros que van a surgir, así como bifurcaciones de estos sistemas -ya que se pueden instalar de manera local y desarrollar habilidades específicas, con datos o tipos de conversaciones restringidas a un área determinada-, tendrá sus propias consecuencias. A mí me parecen herramientas fascinantes, transforman una de las actividades, hasta ahora, privativas del humano: el diálogo y la producción de textos inteligibles en lenguajes humanos. Los sistemas aprenderán con humanos y aquellos humanos que estén investigando de esos sistemas, es un vínculo virtuoso que debe ser explorado, sobre todo, los ámbitos educativos. Así como hoy ya nadie piensa -digámoslo así- sin usar Google y los buscadores integran a la posibilidad de pensar e investigar, de manera tal que se transformó completamente lo que significa investigar.

Integrar estas nuevas maneras cognitivas es la gran novedad. Las instituciones se resienten con ese tipo de cosas, pero -como vengo diciendo- es altamente positivo, a la vez que es un desafío para el cual las instituciones no siempre o, mejor dicho, seguramente no estén preparadas. Estas tecnologías evolucionan a un ritmo completamente inédito y si para algo los humanos no están preparados es para vivir y comprender ese ritmo de evolución. Es una complicación de difícil resolución -institucionalmente-, a la vez que abre a futuros posibles e inciertos. La pérdida de habilidades de parte de docentes y estudiantes es uno de los riesgos, a la vez que el requisito de encontrar nuevas habilidades relevantes para desarrollarse en estos nuevos ambientes técnicos es una condición necesaria y urgente.

—En una reciente nota de Página/12, mencionan que, en Francia, la Universidad Sciences Po fue pionera al prohibir a sus estudiantes el robot conversacional Chat GPT, porque lo considera una copia que puede derivar en sanciones severas y la expulsión de quien lo use sin permiso. Y puede ser usada con autorización del docente para la búsqueda de información y redacción. También fue noticia que, en algunas escuelas de New York, bloquearon el sitio web. ¿Hay que regular el uso del chatbot? ¿Está en riesgo el uso de la información sin chequear? ¿Qué impactos a futuro podrían darse?

—Las regulaciones son necesarias, pero no son suficientes. Más que regular, lo que hace falta es construir proyectos colectivos socio-tecnocognitivos o tecnopolíticos que sirvan para el desarrollo y orientación del uso, integración y formas de apropiación de estas nuevas tecnologías. Se necesita un desarrollo transdisciplinar de las tecnologías digitales y e-learning, que son una etapa, no son la etapa final, porque habrá otras que las superen y en breve. Regular no es el mejor camino para una orientación técnica apropiada y, mucho menos, para que estas tecnologías estén en el camino de la transformación progresiva política.

Lo que está pasando es una transformación radical del mundo, no solo por la aparición de chat GPT -que es un ejemplo-, lo que hay son unas transformaciones tecnológicas interesantísimas, profundas y aceleradas. Y eso implica que los futuros posibles son completamente diversos y contradictorios entre sí, algunos son distópicos y otros más interesantes que pueden encontrar nuevas formas de integración entre humanos y no humanos en los procesos cognitivos, colectivos, políticos, sociales e, inclusive, biológicos.

Y claro que esto produce inquietud, que se puede traducir en un temor conservador o puede asumir un desafío, con todos los cuidados del caso, del concepto mismo de lo humano, de la distribución técnica de la cognición, de la percepción, de la acción colectiva e individual que entran en nuevas etapas, con desafíos inéditos.

—Circulan noticias y posteos sobre las profesiones que ya no van a ser necesarias, no sólo a partir del chatbot, sino a partir del sistema Dall-e de creación de imágenes. ¿Cómo aportamos un debate más útil y menos apocalíptico?

—Hay y habrá una gran transformación de la manera en que se desarrollan ciertas profesiones. Cuando yo era chico, mi primo estudiaba arquitectura y gran parte del trabajo era hacer planos con una fibra en papel, a mano. Hoy, trabajan con distintos sistemas Computer aided design (CAD) que producen los renders de todo el edificio final. Nadie va a pensar que eso mató a la arquitectura, se producen nuevas maneras de construir formas e imágenes, y ciertos trabajos dejan de ser relevantes, por ejemplo, el dibujante de planos. O, por ejemplo, ya nadie hace cálculos a mano desde que está la calculadora. Efectivamente, se transforma el mercado laboral y ciertas profesiones cambiarán su formato usual. Cada vez será más necesaria una alfabetización y comprensión de cómo funcionan estas tecnologías para integrarlas.

Por otro lado, fotos trucadas siempre hubo. Ahora, hay métodos nuevos para construir imágenes con mucha más facilidad. No es que, antes de la IA, una foto era un gran documento inalienable. Dall-e es un sistema que crea imágenes a partir de descripciones lingüísticas y está online hace un año, por lo menos, y resulta divertido jugar con él, generando imágenes a partir de descripciones. Por ejemplo, un pibe creó imágenes con las letras de Los Redondos. Esto no invalida el rol de fotógrafos, para nada, sigue habiendo una necesidad de recuperar imágenes del mundo para comunicar gráficamente cosas. Sólo que ahora tenemos nuevas maneras de producir esos productos, lo mismo pasa con la capacidad de producir textos.

—A raíz de la imagen creada con IA del papa Francisco con camperón, Hernán Brienza posteó: “Hace unos días escribí que con la IA entrábamos en un mundo -ya no de la posverdad- en el que el valor mismo de la verdad no tiene importancia. Posiblemente sea el signo de los tiempos: un mundo sin importancias. Todo análisis político que no parta del impacto de la IA ha quedado obsoleto”. ¿Qué reflexiones podés aportar respecto de este debate?

—Emerge un diagnóstico de algo que ya se sabe hace tiempo, pero que se ve más claro a partir de eso. Comparto lo que dice Brienza; que toda política actual, toda forma de interpretación subjetiva tiene que partir del hecho de que las IA son una forma de mediación, que tiene su propia capacidad de agencia y debe ser entendida en esa clave. No hay ninguna transparencia, pero eso no significa que no haya verdad. La verdad está mediada por una tecnología, no atenta contra la verdad, da nuevos formatos y técnicas que pueden servir para resaltar formas de la verdad o para ocultarla y mentir. Decir la verdad siempre fue una técnica e implicó una manera de pensar y construir esas verdades; hoy, eso se transforma también. Y así como hay muchas formas de mentir, hay otras formas de resaltar, decir y entender las nuevas verdades de este tiempo.

No suscribo una posición distópica o apocalíptica, si bien estamos en un mal momento, todas nuestras instituciones y espacios de reflexión política parten de supuestos que no son más ciertos y, a la vez, no son capaces de dimensionar las enormes posibilidades que estas tecnologías ofrecen en términos de una buena acción política y ética del discurso, y no de usarlas para mentir. Las posibilidades a futuro y de reconstruir proyectos emancipatorios dentro de este marco tecnopolítico, me parece, es uno de los desafíos más interesantes que enfrentamos.

Fuente de la información e imagen: https://latinta.com.ar

Users Today : 102

Users Today : 102 Total Users : 35459568

Total Users : 35459568 Views Today : 161

Views Today : 161 Total views : 3417919

Total views : 3417919