Regina de Miguel

Prohibir el uso de la tecnología en el aula no protegerá a los menores de sus efectos dañinos; es necesario formar en su uso para que los estudiantes desarrollen una actitud crítica y responsable. Así lo cree Manuel Area-Moreira, que ha hablado de este y otros temas en esta entrevista.

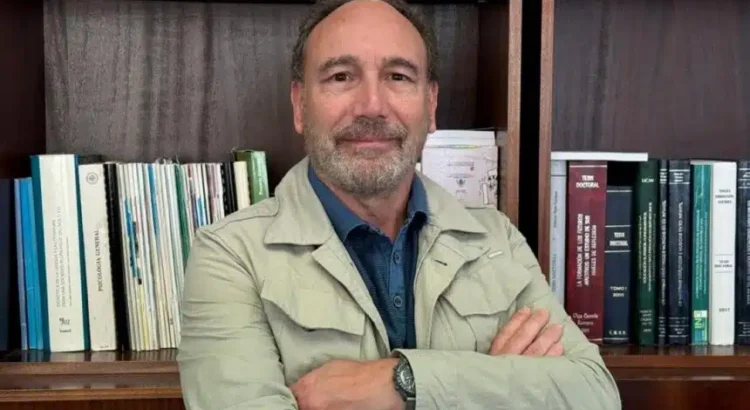

El uso de las pantallas en las aulas ha ocasionado en los últimos tiempos una importante división entre aquellos que las defienden y los que que están en contra de ellas: mientras que los primeros destacan que se fomenta un aprendizaje personalizado, se desarrollan habilidades digitales o se garantiza el acceso a una mayor cantidad de recursos educativos, los segundos hablan de que los dispositivos tecnológicos afectan a la concentración o generan dependencia. Manuel Area-Moreira, catedrático de Tecnología Educativa de la Universidad de La Laguna (Tenerife) e investigador principal del Laboratorio de Educación y Nuevas Tecnologías (EDULLAB), defiende que lo que hay que hacer es formar a los estudiantes para que desarrollen un espíritu crítico, y sean capaces de interactuar con la tecnología, en especial con la inteligencia artificial, de un modo eficaz y seguro.

Pregunta: ¿Qué opina del acalorado debate que ha habido en redes y medios de comunicación en los últimos meses sobre el uso de tecnología en las aulas?

Respuesta: Hay demasiado ruido mediático y mucha confusión en este debate. Es comprensible el malestar y preocupación de las familias y de los docentes ante los efectos nocivos provocados por la sobreutilización de las pantallas por niños y adolescentes, pero considero que es un error la legislación prohibicionista de la tecnología móvil en las aulas. Lo preocupante (y criticable) es que este conjunto de regulaciones administrativas se plantea sin que ofrezcan simultáneamente medidas de actuación educativa ante los problemas enunciados. Subyace la creencia, ingenua a todas luces, que vetando o proscribiendo la presencia de las tecnologías móviles en los espacios escolares se protegerá, de forma casi mágica, a los menores de edad de los efectos dañinos de dichos dispositivos. Tampoco existe ninguna evidencia científica que impidiendo el uso de la tecnología en las aulas el alumnado mejorará su aprendizaje, o que evitará sus efectos negativos como son la tecnoadicción, el consumo de contenidos inapropiados o el ciberbullying. Estas prácticas nocivas de uso de la tecnología por adolescentes ocurren en el tiempo extraescolar, no en los centros educativos. En otras palabras, prohibir los móviles en las aulas no es la solución pedagógica más adecuada.

«Los docentes deben formar a los estudiantes como personas que tienen un equilibrio emocional para usar de manera consciente y autorregulada las redes sociales»

P: ¿Qué habilidades necesita desarrollar el profesorado ante la progresiva digitalización de las aulas?

R: Todo docente, además de dominar el contenido o conocimiento que enseña, debe ser competente didácticamente, es decir, ser capaz de crear las condiciones para facilitar la adquisición del conocimiento por el alumnado. Tiene que ser, asimismo, competente digitalmente y poseer los saberes y las capacidades para utilizar la tecnología con fines pedagógicos. Esta competencia digital consiste en crear materiales didácticos en formato digital, planificar y desarrollar proyectos y actividades de aprendizaje a través de los recursos de Internet, tutorización y evaluar a su alumnado empleando las herramientas tecnológicas, autoformarse y colaborar online con otros colegas docentes, entre otras.

P: ¿Y los desafíos a los que se enfrenta?

R: El principal desafío docente es formar a su alumnado para que sean personas competentes, cultas y críticas que sepan desenvolverse exitosamente en la complejidad cultural y técnica de la sociedad digital. Esto es lo que se conoce como la formación o alfabetización para el desarrollo de la competencia digital del alumnado. Esta competencia no consiste solo en que los estudiantes aprendan a manejar aparatos tecnológicos y software, sino en desarrollar las habilidades intelectuales de alto nivel cognitivo (crear, analizar, comparar, seleccionar, reelaborar) que les permitan interactuar con la información y el conocimiento disponible en el ciberespacio. También debe formarse al alumnado para que sea un sujeto con actitudes, valores y compromiso con los demás. Paralelamente también implica formarles como personas con equilibrio emocional para el uso consciente y autorregulado de las redes sociales y tecnológicas.

P: ¿Qué limitaciones percibe en el uso de las tecnologías en estos momentos?

R: Más que limitaciones, diría que existen usos disfuncionales de la tecnología como son la excesiva dependencia y cantidad de tiempo conectados a la misma por parte de los menores de edad, el acceso a contenidos perniciosos o nocivos (violencia, pornografía, apuestas, acosos, etc.), difusión acelerada del narcisismo o exhibición pública de la vida privada, el consumo y aceptación acrítica de ideas y noticias falseadas… Todo esto son fenómenos preocupantes ante el sobreuso de las redes tecnológicas y necesitan respuestas educativas tanto desde las escuelas como desde los hogares.

P: ¿Cómo introduciría las TIC para garantizar un aprendizaje significativo y personalizado?

R: Hace ya tiempo que sabemos que las TIC, por sí solas, no generan automáticamente aprendizaje en los estudiantes. Ocurre si detrás de la introducción de las TIC en el aula, el docente tiene un planteamiento pedagógico que estimule que el alumnado aprenda de forma activa, constructiva y experiencial. Esto supone articular planificaciones y metodologías didácticas donde se le pida al alumnado que sea un creador de objetos digitales de conocimiento (en formato texto, vídeo, audio…) que pueden compartirse y difundirse en Internet, favoreciendo el trabajo colaborativo y grupal tanto con sus compañeros de clase como con estudiantes de otros centros. Las TIC deben ser utilizadas, didácticamente como recursos que facilitan y permiten al alumnado ser creadores del conocimiento y no meros consumidores del contenido que les proporcionen las pantallas.

«Las TIC garantizan un aprendizaje significativo y personalizado si el docente tiene un planteamiento pedagógico que estimule que el alumnado aprenda de forma activa, constructiva y experiencial»

P: ¿Qué hay que tener en cuenta a la hora de elegir plataformas y herramientas digitales?

R: En la selección de plataformas o herramientas digitales para ser empleadas educativamente debemos estar atentos a que las mismas cumplan una serie de requisitos básicos de respeto a la privacidad de los datos e informaciones personales. Necesitamos plataformas y herramientas digitales que no se apropien y exploten comercialmente los datos generados por los agentes educativos, sino que las mismas sean transparentes y estén al servicio de las necesidades del profesorado y alumnado.

P:¿Qué tecnologías tendrán un impacto mayor en la educación en los próximos años?

R: No soy profeta, pero es predecible que las tecnologías denominadas inteligentes son las que se extenderán e impactarán en los próximos años tanto en nuestra sociedad como en el ámbito educativo. Conceptos como las analíticas del aprendizaje, la tutorización automatizada, la personalización o individualización del aprendizaje, la automatización de los procesos instructivos… probablemente empezarán a estar generalizados en el campo educativo. Asimismo, creo que se producirá un aumento de las modalidades formativas híbridas que supongan una mezcla o combinación de situaciones de enseñanza presencial con espacios de aprendizaje virtuales.

P: En el caso de la inteligencia artificial. ¿Cómo puede esta tecnología mejorar el proceso de enseñanza y aprendizaje? ¿Cuáles son los retos más inmediatos que debe abordar?

R: Actualmente existen numerosas promesas, expectativas y herramientas sobre las aplicaciones de la Inteligencia artificial (IA) en la educación. De hecho, es muy fácil localizar actualmente en Internet cientos de apps que permiten a los docentes y al alumnado de forma automatizada y fácil crear imágenes, generar videos e infografías, traducir idiomas, elaborar resúmenes, redactar ensayos, planificar proyectos, etc.

«El peligro está en que los estudiantes plagien y asuman de modo acrítico lo que les digan las máquinas»

Mi punto de vista es que nos falta o carecemos de un planteamiento o modelo de actuación educativa para integrar didácticamente estas herramientas inteligentes en los procesos de enseñanza. No tiene sentido pedir a los estudiantes las mismas tareas intelectuales que se les solicitaba en los tiempos previos a la IA, ya que estas máquinas se las resuelven en poco tiempo y no suponen un esfuerzo cognitivo relevante en el aprendizaje.

El peligro está en que los estudiantes plagien y asuman de modo acrítico lo que les digan las máquinas. Por ello los nuevos retos formativos son que el alumnado aprenda a formular preguntas y sepa dar las instrucciones necesarias a la IA para que les ofrezca respuestas necesarias y apropiadas para resolver problemas específicos. Que el alumnado aprenda a desarrollar una actitud y de análisis crítico ante las respuestas que proporcione una IA y dialogue con la misma; que sepa que esta tecnología comete errores y por tanto debe verificarse la información que proporciona; y tome conciencia que es una herramienta de apoyo, pero que lo relevante son las personas quienes generan el conocimiento.

Fuente e Imagen: https://www.educaciontrespuntocero.com/entrevistas/manuel-area-moreira/

Desde Cruz Roja Juventud en Zaragoza se están impartiendo talleres en institutos no solo de gestión emocional, sino también de nuevas tecnologías o adicción al móvil. Una práctica inadecuada o excesiva de la tecnología puede desencadenar en ansiedad, fracaso escolar, obesidad, problemas de visión… “Estos talleres que impartimos los solemos llevar a lo práctico, a lo real. Solemos ponernos por ejemplo en la piel de algún famoso que ellos y ellas reconozcan fácilmente…yo suelo hablarles mucho de Ibai, pongo un vídeo suyo donde él cuenta que no es tan fácil ser gamer, habla de todo lo que conlleva y los límites que hay que poner a la hora de navegar por redes sociales”, defiende Ernesto Vegas, voluntario y referente de Cruz Roja Juventud en Zaragoza.

Desde Cruz Roja Juventud en Zaragoza se están impartiendo talleres en institutos no solo de gestión emocional, sino también de nuevas tecnologías o adicción al móvil. Una práctica inadecuada o excesiva de la tecnología puede desencadenar en ansiedad, fracaso escolar, obesidad, problemas de visión… “Estos talleres que impartimos los solemos llevar a lo práctico, a lo real. Solemos ponernos por ejemplo en la piel de algún famoso que ellos y ellas reconozcan fácilmente…yo suelo hablarles mucho de Ibai, pongo un vídeo suyo donde él cuenta que no es tan fácil ser gamer, habla de todo lo que conlleva y los límites que hay que poner a la hora de navegar por redes sociales”, defiende Ernesto Vegas, voluntario y referente de Cruz Roja Juventud en Zaragoza.

Users Today : 110

Users Today : 110 Total Users : 35460016

Total Users : 35460016 Views Today : 165

Views Today : 165 Total views : 3418630

Total views : 3418630